Dieser KI wird alles für Sie erledigen: Google startet Gemini 2.5 Computer Use, das mit Webschnittstellen arbeitet

Google DeepMind hat ein neues spezialisiertes KI-Modell vorgestellt — Gemini 2.5 Computer Use, das zur Erstellung von KI-Agenten bestimmt ist, die in der Lage sind, mit grafischen Schnittstellen genauso zu interagieren wie ein Mensch.

Was kann Gemini 2.5 Computer Use

- Navigation durch Schnittstellen: Die KI kann klicken, Text eingeben, Seiten scrollen, Formulare ausfüllen, mit Dropdown-Listen arbeiten und sogar Aktionen hinter einem Login durchführen.

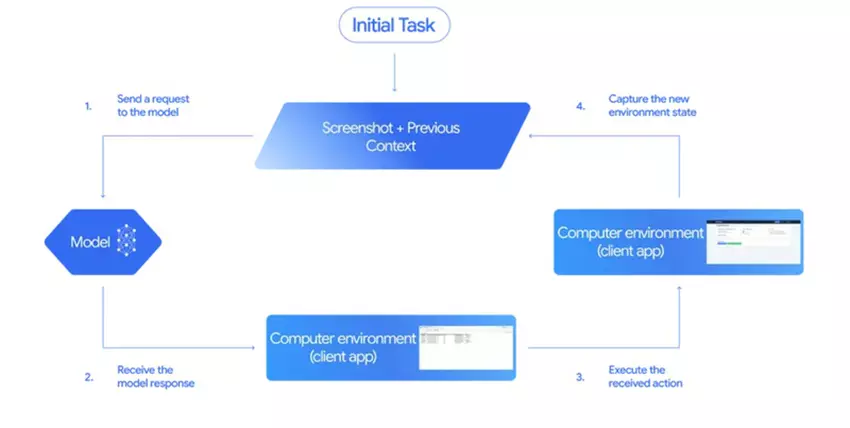

- Schnittstellenzyklus: Die Interaktion erfolgt nach dem Prinzip „Anfrage → Aktion → Screenshot → Analyse → nächste Aktion“, bis die Aufgabe abgeschlossen ist.

- Unterstützung für Web- und mobile Schnittstellen: Das Modell ist für Browser optimiert, zeigt jedoch auch bei mobilen Schnittstellen gute Ergebnisse. Die Unterstützung für Desktop-Betriebssysteme ist derzeit eingeschränkt.

Wie funktioniert das?

Das Modell erhält die Anfrage des Benutzers, macht einen Screenshot der aktuellen Schnittstelle und analysiert die Historie der vorherigen Aktionen. Basierend auf diesen Daten führt es eine Aktion aus, zum Beispiel „Taste drücken“ oder „Text eingeben“. Einige Aktionen erfordern die Bestätigung des Benutzers, insbesondere wenn es um Einkäufe oder sensible Operationen geht.

Funktionsweise?von Gemini 2.5 Computer Use

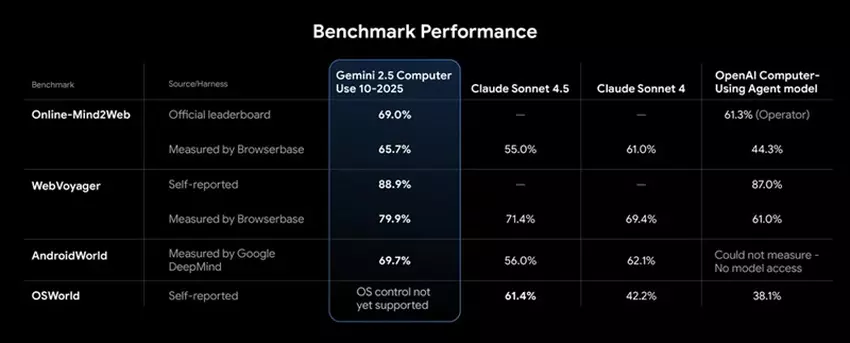

Gemini 2.5 Computer Use demonstriert:

- hohe Genauigkeit bei den Benchmarks Browserbase und Online-Mind2Web,

- niedrige Latenz im Vergleich zu Alternativen,

- bis zu 50 % schnellere Leistung (basierend auf vorläufigen Tests).

Um die Sicherheit der persönlichen Daten der Benutzer zu gewährleisten, hat Google ein Schutzsystem gegen bösartige Aktionen, unerwartetes Verhalten und Angriffe über Webschnittstellen (z.B. Prompt Injection) in das Modell integriert.

Für Entwickler steht ein Set von Werkzeugen zur Verfügung, darunter die Bewertung jeder Aktion vor der Ausführung und systemweite Anweisungen, die riskante Operationen verbieten oder eine Bestätigung erfordern.

Das Modell wird bereits im UI-Testing (darunter in Project Mariner und Firebase Testing Agent), in der Automatisierung von Arbeitsabläufen und bei der Erstellung persönlicher Assistenten eingesetzt.

Das Modell ist bereits in einer öffentlichen Vorschau-Version über die API Gemini in Google AI Studio und Vertex AI verfügbar.

Quelle: Google Blog