Claude Opus 4.6: Wenn die KI plötzlich Überstunden schiebt

Anthropic hat mit dem Opus 4.6 ein Modell veröffentlicht, das die bisherigen Maßstäbe für autonome Problemlösung nicht nur verschiebt, sondern regelrecht sprengt. Während die Konkurrenz aus dem Hause OpenAI mit GPT-5.2 noch versucht, die Sechs-Stunden-Marke stabil zu halten, erledigt dieses Modell Aufgaben, für die ein erfahrener Ingenieur fast zwei volle Arbeitstage einplanen müsste. Es geht hier nicht mehr um ein bisschen mehr Geschwindigkeit, sondern um eine völlig neue Qualität des digitalen Denkens.

Der Benchmark, der die Spreu vom Weizen trennt

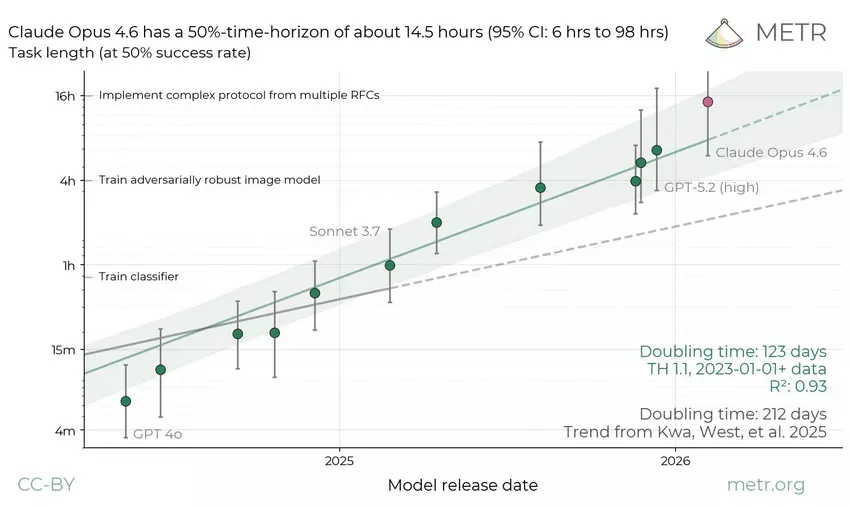

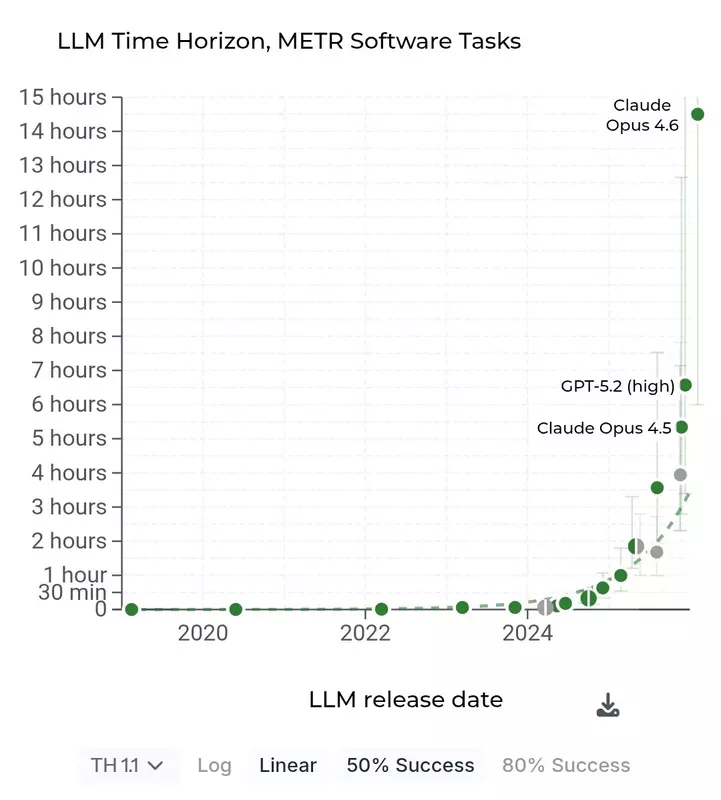

Die Organisation METR (Model Evaluation and Threat Research), bekannt für ihre gnadenlosen und unabhängigen KI-Tests, hat neue Daten zum sogenannten „Time Horizon“ veröffentlicht. Dieser Wert gibt an, wie viele Stunden menschlicher Arbeit ein Modell mit einer Erfolgswahrscheinlichkeit von 50 % autonom ersetzen kann. Die Ergebnisse sind für die Konkurrenz ernüchternd:

- GPT-5: ~4 Stunden

- Claude Opus 4.5: ~5 Stunden

- GPT-5.2 (high): ~6.5 Stunden

- Claude Opus 4.6: ~14.5 Stunden

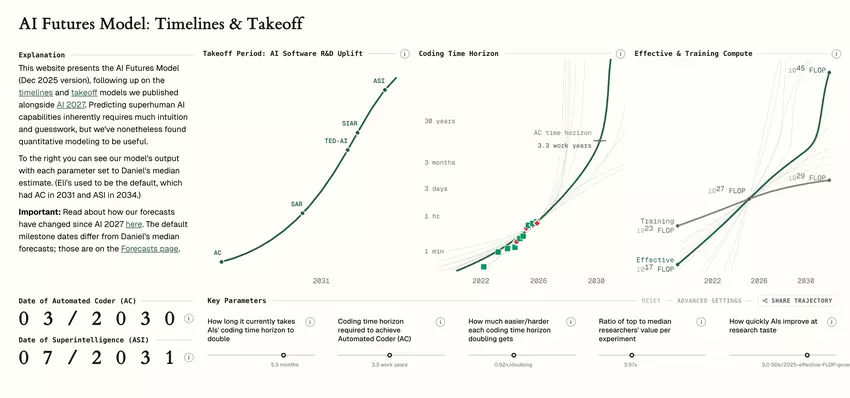

Opus 4.6 ist damit nicht nur ein bisschen besser als sein Vorgänger. Es übertrifft GPT-5.2 um das Zweifache und lässt den eigenen Vorgänger, Opus 4.5, mit einem Faktor von 2.7 hinter sich. In der Welt der Algorithmen ist das kein einfacher Fortschritt, das ist ein Ausreißer, der die bisherige exponentielle Kurve nach oben verlässt. Wenn eine KI über 14 Stunden hinweg an einem Problem arbeiten kann, ohne sich in logischen Sackgassen zu verlieren, reden wir nicht mehr über Chatbots, sondern über autonome Agenten.

Komplexität statt Kurzzeitgedächtnis

Was bedeutet das in der Praxis? Es geht nicht darum, einen Tippfehler in 50 Zeilen Code zu finden. Opus 4.6 ist in der Lage, komplexe Fehler in gewaltigen Machine-Learning-Codebasen von Forschungsprojekten zu identifizieren und eigenständig zu beheben. Wo andere Modelle nach einer Stunde anfangen zu „halluzinieren“ oder den Kontext der Aufgabe vergessen, bleibt dieses Modell präzise.

Besonders auffällig ist die Fähigkeit zur Dekomposition: Das Modell zerlegt komplexe Problemstellungen von sich aus in logische Einzelschritte, anstatt blindlings drauflos zu generieren. Das reduziert die Fehlerquote massiv und sorgt dafür, dass die Ergebnisse auch bei Aufgaben, die tiefes technisches Verständnis erfordern, brauchbar bleiben. Anthropic scheint hier einen Weg gefunden zu haben, das logische Schlussfolgern vom bloßen statistischen Raten zu entkoppeln.

Präzision hat ihren Preis

Natürlich gibt es das Ganze nicht zum Nulltarif. Opus 4.6 ist teurer als seine Konkurrenten und sogar teurer als die eigenen Vorgänger. Doch wer im professionellen Umfeld arbeitet, weiß, dass die Kosten für die Rechenleistung vernachlässigbar sind, wenn die Qualität der Ergebnisse stimmt. Ein Modell, das seltener halluziniert und den Kontext über lange Zeiträume hält, spart am Ende teure menschliche Korrekturzeit.

Während Anthropic die Messlatte für reine Rechenpower und Logik nach oben schraubt, konzentriert sich die Konkurrenz oft auf die schiere Reichweite ihrer Dienste. So expandiert Google Gemini in Chrome und ist nun in Regionen wie Kanada und Indien verfügbar, um die breite Masse zu erreichen, während anspruchsvolle Anwender wohl eher zum neuen Opus-Modell greifen dürften.